La IA firma a diez años: Anthropic promete 100.000 millones a Amazon

Amazon refuerza su ofensiva de chips y nube con 5.000 millones inmediatos en la creadora de Claude, en una alianza que mezcla músculo, dependencia y control de costes.

La cifra es de otra escala: más de 100.000 millones de dólares comprometidos a una sola nube durante 10 años. Anthropic, una de las casas fuertes de la IA generativa, convierte a AWS en su autopista principal. Amazon, por su parte, mete más dinero en la mesa: 5.000 millones ahora y hasta 20.000 millones después, además de lo ya invertido. Lo que se firma no es solo capacidad: es una relación de dependencia diseñada para durar. Y en la industria que presume de agilidad, la estabilidad —en chips— ya manda más que el talento.

Una factura de 100.000 millones para asegurar el suministro

El anuncio cristaliza una realidad que el sector llevaba meses maquillando: entrenar y servir modelos punteros ya no es un problema de software, sino de abastecimiento. Anthropic se compromete a gastar más de 100.000 millones en tecnologías de AWS, incluyendo generaciones actuales y futuras de Trainium. Traducido: una media de 10.000 millones al año para no quedarse sin gasolina computacional.

La consecuencia es clara: la nube deja de ser un proveedor intercambiable y se convierte en socio estratégico con llave del crecimiento. El pacto incorpora, además, capacidad a gran escala para entrenamiento e inferencia. En un mercado donde la escasez se mide en potencia eléctrica y plazos de centro de datos, el número funciona como salvavidas… y como cadena.

El chip propio como moneda en la guerra contra Nvidia

En esta historia, el protagonista no es Claude: es el silicio. El acuerdo enumera explícitamente Trainium2, Trainium3 y Trainium4, más la opción de adquirir generaciones futuras. Es la forma de Amazon de convertir su chip en estándar de facto y, de paso, arañar la dependencia del ecosistema dominante sin decirlo.

La escala ya es tangible: el superclúster levantado para Anthropic opera con cientos de miles de aceleradores y aspira a superar el millón para sostener a Claude. El contraste con la década pasada resulta demoledor: antes el cuello de botella era el “time-to-market”; hoy es el “time-to-power”. Y lo más grave: el cambio de prioridades. Estos chips nacieron para entrenamiento; ahora se optimizan también para inferencia, porque ahí está el atasco real, el coste recurrente y el margen futuro.

Claude dentro de AWS: integración que ata al cliente

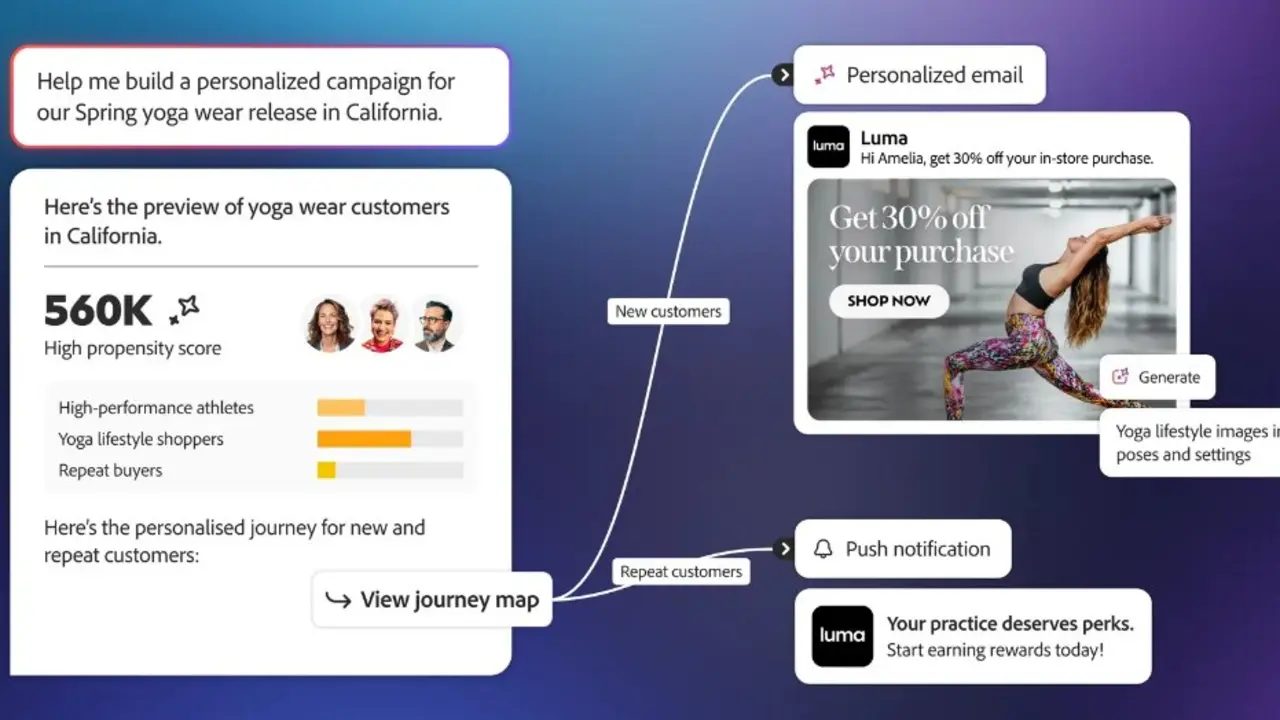

Amazon no solo vende computación; vende una experiencia cerrada. El acuerdo incorpora un paso clave: los clientes de AWS podrán acceder a la consola nativa de Claude desde el propio entorno de AWS. Es cómodo, sí. También es la forma más limpia de encerrar al cliente dentro de un perímetro: control de identidades, trazabilidad, monitorización y facturación, todo por la misma tubería.

La escala ya es significativa: decenas de miles de empresas ejecutan modelos de Anthropic en la infraestructura de Amazon. Con este movimiento, Amazon reduce fricción comercial y Anthropic gana distribución corporativa inmediata. Sin embargo, el precio implícito es la migración inversa: una vez el flujo de trabajo vive en esa consola, sacarlo duele.

«Nuestros usuarios dicen que Claude es cada vez más esencial y necesitamos infraestructura para seguir el ritmo de una demanda que crece a toda velocidad».

5.000 millones ahora y 20.000 después: Amazon compra influencia

La letra pequeña del dinero también importa. Amazon invertirá 5.000 millones hoy y hasta 20.000 millones adicionales ligados a hitos comerciales, además de lo comprometido previamente. No es capital romántico: es financiación condicionada al rendimiento, diseñada para alinear ingresos y permanencia en AWS.

Este hecho revela una estrategia doble. Por un lado, Amazon blinda un cliente hiperintensivo en computación que empuja su negocio de infraestructura. Por otro, gana una influencia decisiva en un actor que compite por talento, contratos y narrativa de seguridad en IA. En el mercado, este tipo de anuncios se interpreta como señal de tracción, pero también como aviso: la consolidación se está haciendo por contrato y por capacidad, no por promesas.

El coste energético que nadie quiere mirar

La IA ya no se mide solo en parámetros; se mide en kilovatios. Comprometer capacidad a gran escala no es una cláusula técnica: es una declaración industrial. A mayor demanda de inferencia, mayor presión sobre costes energéticos, refrigeración y tolerancia social a centros de datos. El debate se mueve del laboratorio al transformador eléctrico.

En paralelo, este tipo de compromisos obligan a los proveedores a prometer eficiencia por diseño: mejor “precio-rendimiento” o la cuenta no sale. Y cuando la cuenta manda, la innovación se subordina al coste. La consecuencia es un reequilibrio silencioso: menos fuegos artificiales y más ingeniería de infraestructura.

Alianzas cruzadas y nueva geometría del poder

El tablero se está reordenando a velocidad de vértigo. Las grandes tecnológicas ya no compiten solo por modelos; compiten por suministro, por integración y por contratos a década vista. El laboratorio que asegura energía y chips gana tiempo; el que no, se queda explicando caídas de rendimiento como si fueran simples incidencias.

El diagnóstico es inequívoco: la industria entra en una fase donde los acuerdos de infraestructura pesan tanto como la calidad del algoritmo. En ese escenario, la pregunta no es quién tiene la IA más lista hoy, sino quién podrá pagar la próxima ronda de capacidad sin romper su propio relato de rentabilidad.