Gemini podría entrar en el Pentágono: acuerdo para uso en “clasificado”

Google busca un contrato que limite vigilancia interna y armas autónomas.

La Casa Blanca ya trata la IA como infraestructura de seguridad nacional. Y el Pentágono, con un presupuesto de 961.600 millones de dólares y casi 3 millones de empleados, quiere modelos punteros también en entornos secretos. Google negocia para que Gemini opere en redes clasificadas, pero exige un cerrojo: nada de vigilancia masiva doméstica ni de armas autónomas.

Un giro estratégico en los pasillos del Pentágono

Las conversaciones entre Google y el Departamento de Defensa apuntan a un salto cualitativo: no se trataría solo de pilotos “de oficina” o usos administrativos, sino de habilitar a Gemini en entornos clasificados. La información, revelada por The Information y replicada por agregadores del sector, describe unas negociaciones “encarriladas” hacia un acuerdo que permitiría al Pentágono desplegar los modelos para “todos los usos legales”.

El contexto explica la prisa. Defensa es uno de los mayores compradores de tecnología del planeta: maneja un presupuesto cercano al billón y adjudica alrededor de 205.000 millones en contratos de servicios. En ese ecosistema, el proveedor que consiga entrar en el “clasificado” no solo gana un cliente: gana un estándar. Y, con él, la capacidad de marcar qué se considera aceptable cuando la IA se conecta a la cadena de mando.

La línea roja: vigilancia interna y armas autónomas

Lo más relevante no es la tecnología, sino la letra pequeña. Según las filtraciones, Google intenta blindar el contrato para impedir dos usos que concentran la controversia: vigilancia masiva en territorio estadounidense y armas autónomas.

La razón es doble. Por un lado, reputacional: la marca sabe que su historial con Defensa sigue siendo un campo minado desde 2018, cuando miles de empleados se rebelaron contra Project Maven, el programa para analizar imágenes y vídeo con IA. Por otro, regulatoria y contractual: la Administración quiere proveedores dispuestos a operar bajo el marco legal vigente, pero las empresas buscan fórmulas que no dejen grietas interpretativas. «La vigilancia masiva con IA choca con valores democráticos», resumió Anthropic en un comunicado reciente.

El precedente OpenAI y el pulso con Anthropic

Google no negocia en el vacío: llega después de que OpenAI anunciara, el 28 de febrero de 2026, un acuerdo para que sus modelos se usen en una “red clasificada”, con un refuerzo posterior del lenguaje para subrayar que no se emplearán en vigilancia doméstica ni en sistemas de armas autónomas.

Ese precedente ha reordenado el mercado. Anthropic, que había trazado “líneas rojas” similares, chocó con el Pentágono en un tira y afloja público: reuniones tensas, ultimátums y una disputa sobre hasta dónde deben llegar las salvaguardas en el papel. El resultado práctico es un mensaje a las tecnológicas: el Departamento no quiere solo modelos; quiere capacidad operativa sin litigios permanentes. Y eso convierte cada verbo del contrato en un campo de batalla.

Por qué ahora: urgencia operativa y carrera industrial

La aceleración tiene un motor obvio: la IA se ha convertido en ventaja comparativa en inteligencia, ciberdefensa, logística y planificación. Con un aparato de casi 3 millones de personas, el Pentágono busca automatizar tareas y reducir fricción burocrática a escala. No es casual que, en paralelo, Google ya haya ampliado iniciativas para usos no clasificados dentro del Departamento, mientras se explora el siguiente paso hacia material sensible.

El diagnóstico es inequívoco: la presión no viene solo de China o del tablero geopolítico, sino del propio gasto. Cuando el presupuesto roza 961.600 millones, cualquier mejora de productividad —aunque sea del 1%— equivale a miles de millones reasignables. En ese marco, la IA deja de ser “innovación” y pasa a ser contabilidad estratégica.

El cuello de botella del “clasificado”: datos, redes y control

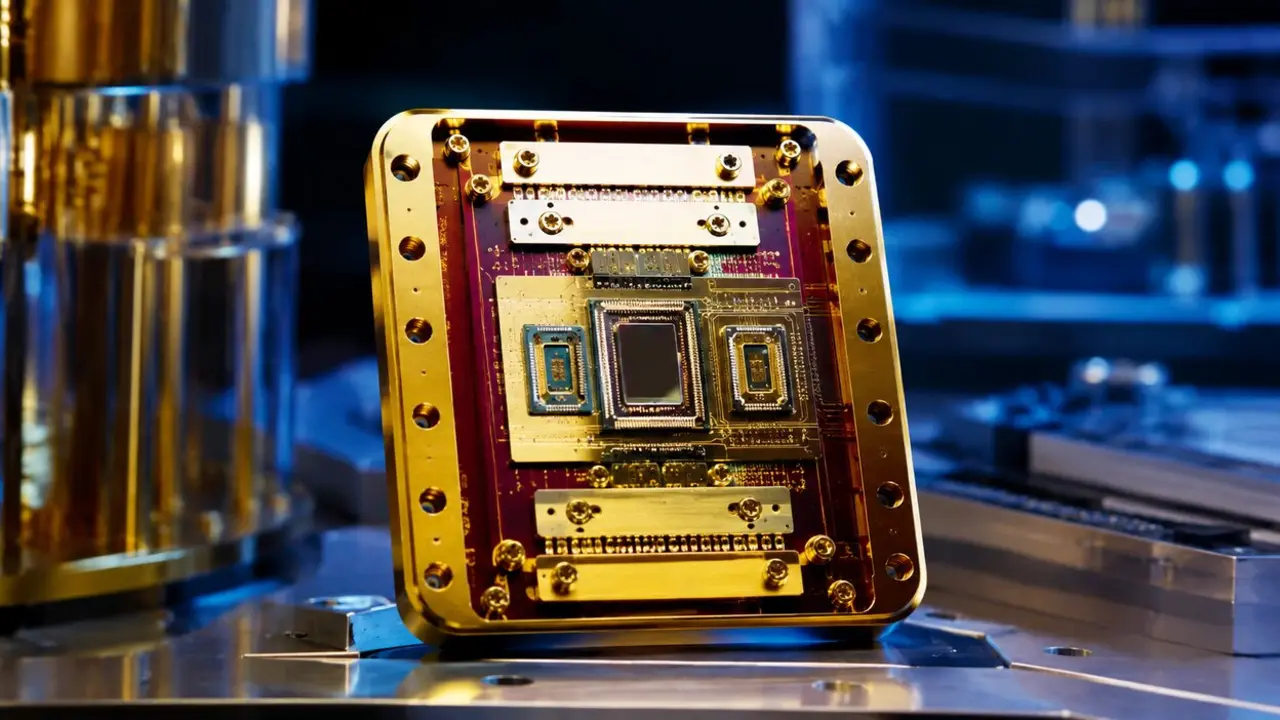

Entrar en el “clasificado” no es instalar un chatbot: es integrarse en un ecosistema donde el dato es munición. Redes como SIPRNet o JWICS exigen aislamiento, trazabilidad y controles extremos; lo que en la nube comercial es una API, aquí es un proceso de acreditación y arquitectura de seguridad.

Por eso las cláusulas importan tanto como los chips. El Pentágono pretende un marco de “usos legales” amplio; las compañías temen que ese paraguas acabe justificando prácticas que, aunque legales, sean políticamente tóxicas o técnicamente arriesgadas. El contraste con la IA en entornos civiles resulta demoledor: en Defensa, un fallo no es una mala recomendación de compra; puede ser un incidente operativo. De ahí el énfasis en mantener al humano en la toma de decisiones y en delimitar qué “automatiza” la IA y qué no debe automatizar jamás.

El coste reputacional para Google y el efecto dominó que viene

Para Google, el movimiento tiene un precio: reabrir una discusión interna que parecía enterrada tras Maven. En 2018, la presión de los empleados obligó a la empresa a recalibrar su relación con Defensa y a formular principios públicos sobre usos aceptables de la IA. Volver ahora al “clasificado” implica explicar —con precisión quirúrgica— por qué esto no es lo mismo.

Pero también hay un incentivo: si OpenAI ya está dentro y otros proveedores compiten por el mismo espacio, quedarse fuera puede suponer perder el tren de los estándares militares de IA para la próxima década. La consecuencia es clara: el acuerdo que se firme —si se firma— marcará el listón para el resto. Y, en Washington, cuando un contrato fija lenguaje sobre vigilancia y armas autónomas, ese lenguaje se convierte en moneda política. El “clasificado” no solo protege secretos: define quién manda en la próxima capa tecnológica del Estado.